Stanford AI Index 2026: La IA acelera, pero ¿quién controla el rumbo?

Stanford AI Index 2026: La IA acelera, pero ¿quién controla el rumbo?

La paradoja del progreso sin frenos

El Stanford AI Index 2026 acaba de confirmar lo que muchos sospechábamos: la IA avanza a una velocidad histórica, pero nuestra capacidad para medirla, gestionarla y asegurarla se queda atrás. No es una cuestión de si la IA transformará tu negocio, sino de si estarás preparado cuando lo haga.

El informe de 423 páginas publicado por el Instituto de Inteligencia Artificial Centrada en el Ser Humano de Stanford revela una industria en plena ebullición: récords de inversión, adopción más rápida que la del PC o Internet, y capacidades técnicas que han alcanzado hitos impresionantes en ciencia y matemáticas.

Pero hay otra cara de la moneda: una brecha creciente entre lo que los modelos pueden hacer y el rigor con que se evalúan para detectar daños.

1. Adopción masiva: el riesgo oculto tras las cifras

El dato: La IA generativa alcanzó el 53% de adopción poblacional en solo tres años, superando la velocidad de adopción del PC e Internet. El valor que los consumidores obtienen de la IA generativa creció un 54% en un año, alcanzando $172 mil millones anuales solo en Estados Unidos.

El problema: Esta adopción explosiva esconde una realidad peligrosa. Mientras las cifras de adopción organizacional alcanzan el 88%, lo que el informe no captura es el fenómeno del "Shadow AI": empleados usando herramientas de IA sin supervisión, políticas claras ni control sobre los datos corporativos.

La pregunta que debes hacerte: ¿Tu empresa está usando IA o está siendo usada por ella? Hay una diferencia crítica entre adopción y control.

2. El dilema de la confiabilidad: cuando los modelos más potentes son los menos transparentes

El dato crítico: Las tasas de error en benchmarks pueden llegar hasta el 42% en evaluaciones ampliamente utilizadas como GSM8K. Los modelos actuales no logran distinguir sistemáticamente entre conocimiento y creencia, poniendo en riesgo procesos críticos en medicina, legal y finanzas.

La realidad opaca: La industria produce el 90% de los modelos de frontera, pero estos son cada vez menos transparentes en cuanto a sus datos de entrenamiento y código. De 95 modelos representativos, 80 no divulgan su código de entrenamiento.

Para tu negocio: No puedes construir decisiones estratégicas sobre "cajas negras" algorítmicas. La transparencia no es un lujo académico; es una necesidad operacional.

3. Seguridad rezagada: los números que nadie quiere ver

El dato alarmante: Los incidentes documentados con IA aumentaron a 362 en 2025, frente a 233 en 2024—un incremento del 55%. La media móvil de seis meses alcanzó 326 incidentes, con un pico de 435 en un solo mes.

La brecha crítica: Casi todos los desarrolladores de modelos de frontera reportan resultados en benchmarks de capacidad. Lo mismo NO es cierto para los benchmarks de IA responsable. La tabla de benchmarks de seguridad del informe está mayormente vacía: solo Claude Opus 4.5 reporta resultados en más de dos benchmarks de IA responsable.

El mensaje: El riesgo no es futuro; es hoy. Las empresas que asumen que "los grandes laboratorios ya se encargan de la seguridad" están apostando su reputación (y sus datos) en fe ciega.

4. Regulación en transición: más allá del GDPR

El cambio de paradigma: El interés por GDPR ha bajado ligeramente (del 65% al 60%), mientras que estándares específicos de IA como ISO/IEC 42001 (36%) y el marco de riesgos del NIST (33%) ganan terreno rápidamente.

Lo que significa: El cumplimiento legal en IA ya no es solo "marcar la casilla del GDPR". Los reguladores y el mercado están exigiendo marcos específicos para los riesgos únicos que plantea la inteligencia artificial.

Tu ventaja competitiva: Las empresas que se adelanten a esta transición regulatoria no solo evitarán multas; ganarán confianza del cliente y ventaja competitiva.

5. La brecha China-EE.UU. se cierra: lo que nadie esperaba

El dato sorprendente: Modelos de EE.UU. y China han intercambiado posiciones de liderazgo múltiples veces desde principios de 2025. El modelo estadounidense líder aventaja por solo 2.7% al chino en marzo de 2026.

La realidad geopolítica: China ahora lidera en volumen de publicaciones, participación en citas y concesiones de patentes. DeepSeek-R1 igualó brevemente al mejor modelo estadounidense en febrero de 2025.

Para empresas globales: La competencia en IA ya no es bipolar. Las estrategias tecnológicas deben contemplar un ecosistema multipolar donde la innovación viene de múltiples geografías.

6. Percepción pública vs. realidad: la desconexión crece

La división: Casi dos tercios de los estadounidenses (64%) esperan que la IA conduzca a menos empleos en los próximos 20 años, mientras que solo el 5% espera más. Los expertos son menos pesimistas (39% prevén menos empleos).

El impacto laboral real: Las posiciones de nivel de entrada han caído dramáticamente, con empleos de desarrollo para el grupo de edad 22-25 viendo un recorte del 20%.

Tu responsabilidad: La IA no es neutral. Las empresas que adopten IA de manera responsable necesitan ser transparentes sobre su impacto en la fuerza laboral y preparar programas de reentrenamiento.

Conclusión: ¿Pasajero o piloto?

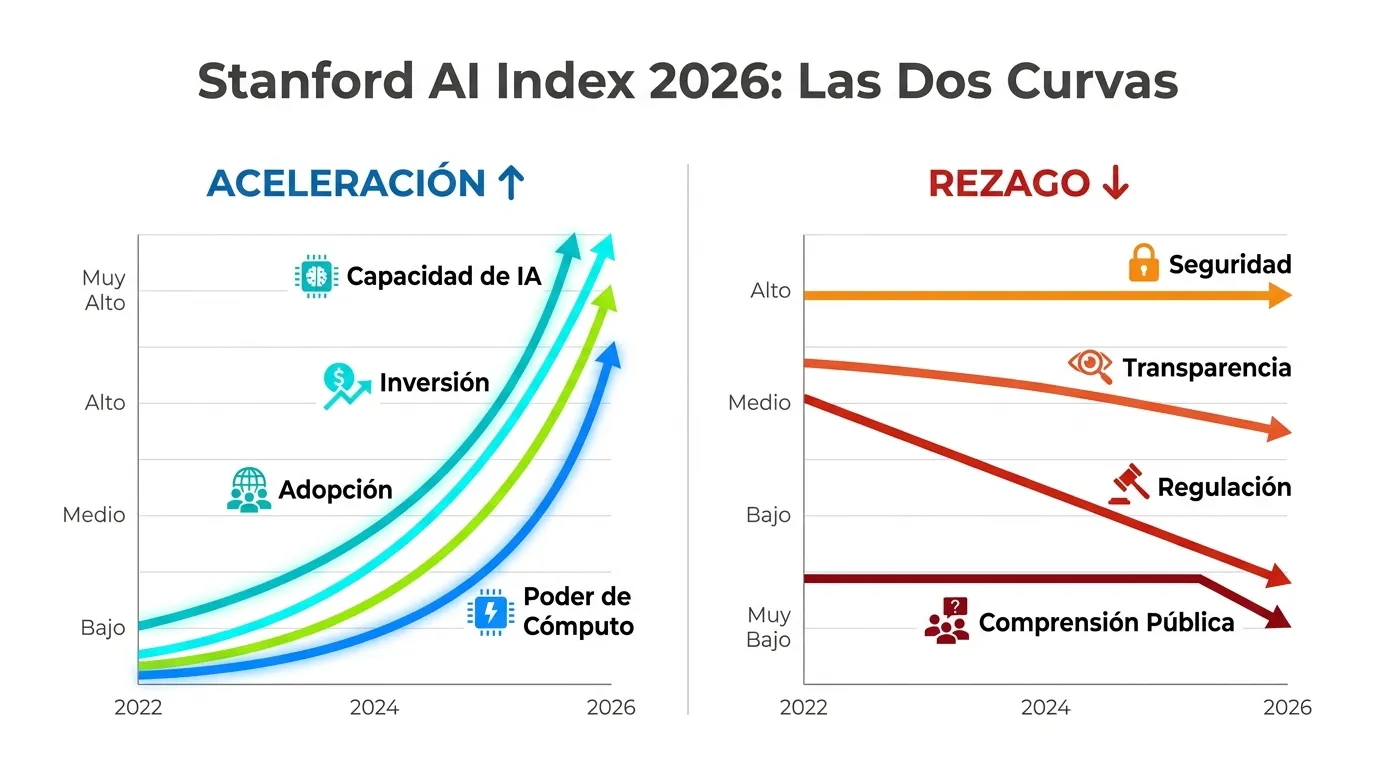

El Stanford AI Index 2026 dibuja una imagen clara: la IA acelera, y todo lo demás se queda atrás.

Si representáramos el informe en una sola gráfica, tendríamos curvas ascendentes exponenciales de capacidad de modelos, poder de cómputo, inversión y adopción. Y curvas planas o descendentes en transparencia, seguridad, comprensión pública y capacidad regulatoria.

La pregunta ya no es "¿Qué traerá el futuro?" sino "¿En qué curva estás?"

En Montevive.AI creemos que no hay que elegir entre innovación y seguridad. Nuestra misión es simple: 100% IA, 99% seguridad. Ayudamos a empresas a estar en la curva ascendente de capacidad sin caer en la curva descendente de control.

¿Hablamos de cómo tomar el control de tu IA antes de que ella tome el control de ti?

Para saber más:

- Descarga el informe completo (423 páginas, PDF)

- 12 conclusiones clave del AI Index 2026 (Stanford HAI)

- Análisis técnico del informe (Rendimiento y benchmarks)

¿Necesitas evaluar el riesgo de Shadow AI en tu empresa? Contacta con nosotros para un diagnóstico inicial sin compromiso.